Guizzi di intelligenza artificiale “controcorrente”

Si è tenuto lo scorso 25 marzo in FBK un confronto fra esponenti di primo piano nella ricerca nel campo dell'IA e dell’Intelligenza Aumentata. Abbiamo raccolto la testimonianza video di Alessandro Sperduti, Marco Gori e Oliviero Stock, ospiti di "Some Pills of AI Against the Tide"

L’incontro, introdotto e coordinato da Paolo Traverso, ha visto alternarsi i contributi alla riflessione e al dibattito dei ricercatori senior di FBK Bernardo Magnini (Chatting with a Generative AI: a Personal Review) e Luciano Serafini (Planning and Acting to Learn) e ha ospitato l’intervento di Oliviero Stock, già direttore dell’ITC-IRST (prima dell’istituzione della Fondazione Bruno Kessler) e pioniere della ricerca di settore a partire dagli anni ottanta del secolo scorso.

Nel suo intervento, intitolato The art of making wrong predictions about AI: a modest contribution, ha messo a fuoco, attraverso un’accorata testimonianza di una lunga esperienza professionale e umana, questioni epistemologiche che riguardano le sfide etiche e il mutamento sociale legati allo sviluppo e all’evoluzione della ricerca nel campo dell’intelligenza artificiale.

“C’è un grande interesse per quanto riguarda l’AI. Soprattutto, il cambio di paradigma che c’è stato verso l’AI generativa porta a un nuovo rapporto fra persona e sistema intelligente. Anni fa noi ricercatori cercavamo di replicare l’umano e interagire con le macchine come avremmo interagito con un’altra persona oppure miravamo ad avere sistemi completamente autonomi che intervenissero nella nostra società. Una buona prospettiva di ricerca ora è quella dell’augmentation, l’estensione dell’intelligenza umana. Nello spirito che aveva Engelbart, che già nel 1960 all’SRI aveva stabilito un centro per l’Augmentation.

Se ci chiediamo quale sarà il futuro per il mondo del lavoro, dal punto di vista pratico, certamente la transizione verso sistemi intelligenti, un po’ come in ogni rivoluzione industriale, comporta il rischio di sostituire posti di lavoro, un rischio che adesso è innegabilmente presente, una cosa dolorosa per coloro che verranno coinvolti e che tocca alla politica ovviare, ma in prospettiva si creeranno anche tipologie di lavoro del tutto nuove che ancora non hanno posto nella società di oggi.

Complemento di questo cambiamento, volendo essere ragionevolmente ottimisti, è il fatto che potrà essere dato un maggior valore a tratti e aspetti tipici dell’essere umano come la gentilezza, l‘empatia e la creatività. Caratteristiche spesso associate a mestieri umili o sottovalutati nella società odierna. Spero che, anche grazie a questa grande trasformazione socio-tecnica, queste qualità squisitamente umane verranno valorizzate di più.

Passando dalle opportunità ai rischi, il problema per me numero uno in questa fase delicata di rapido cambiamento è la concentrazione nelle grandi corporation. Tre sono a mio avviso i fattori chiave:

- La società ha lasciato che le corporation accumulassero i dati individuali

- In pratica solo le grandi aziende possono permettersi le risorse di calcolo necessarie per il tipo di elaborazione attuale

- Molti talenti sono stati rastrellati dalle aziende dotate dei migliori centri di ricerca, tanto che questi centri sono diventati attrattivi non solo per motivi economici ma anche intellettuali.

Per tutte queste ragioni la ricerca di settore si autoalimenta quindi dentro le corporation stesse, una cosa molto pericolosa. Bisognerebbe almeno bilanciare questo fenomeno dando un ruolo importante alla ricerca pubblica.

Per quanto riguarda l’atteggiamento pubblico dell’UE è molto importante la regolamentazione, ma è importante che ci sia anche una visione dell’IA positiva, come strumento privilegiato per salvare la nostra democrazia, contrastando le fake news o facendo prevenzione rispetto all’influenzamento elettorale nascosto. L’IA può fornire strumenti determinanti per aiutarci a salvare la nostra società.

Va in questa direzione la proposta che circola da qualche anno di istituire un CERN per la sicurezza dell’IA e la sicurezza globale, avanzata per la prima volta da Gary Marcus nel 2017 riscuotendo largo consenso nell’accademia. Costruire un mondo positivo con l’IA è possibile, ma non possiamo darlo per scontato.

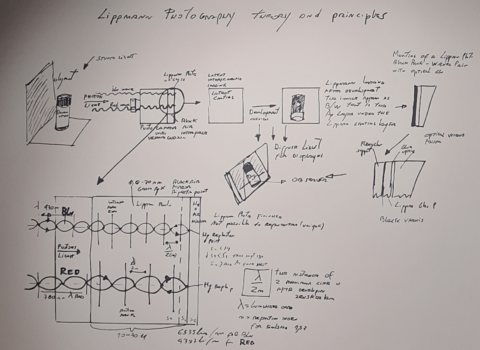

Il contributo di Marco Gori (a capo del Siena Artificial Intelligence Lab), intitolato Foundations of Attention Learning si è concentrato su una proposta di ricerca per certi aspetti provocatoria, descrivendo, a partire da brillanti riferimenti interdisciplinari, un nuovo paradigma per l’intelligenza artificiale, un’AI senza dati, collectionless. In particolare, alla base della sua riflessione c’è il ruolo creativo del tempo inteso come protagonista dell’apprendimento nelle reti neurali. L’ispirazione della proposta teorica avanzata può essere riassunta in una domanda: in che modo i paradigmi della fisica possono aiutarci a trovare nuovi stili di apprendimento, possibilmente più adatti alle nostre sfide di problem solving? Grazie a un’affascinante visione pre-algoritmica del (machine) learning, la centralità del tempo come fenomeno fisico restituisce una concezione generale dell’intelligenza artificiale intuitivamente più vicina all’esperienza umana.

Alla discussione ha preso parte anche il Prof. Alessandro Sperduti, Università di Padova:

“Da sempre gli esseri umani hanno cercato di costruire strumenti per potenziare le proprie capacità fisiche. Quello che cambia adesso, con le nuove tecnologie disponibili, è la possibilità di replicare funzioni cognitive che in passato erano appannaggio esclusivamente della singola persona. L’intelligenza aumentata, essendo digitale e replicabile a dismisura, può essere diffusa in un istante in tutto il mondo connesso. In questo modo, l’esperienza di tanti esseri umani confluisce in un sistema intelligente che si migliora continuamente. Questo è quel che è accaduto con l’intelligenza artificiale generativa che ha rielaborato con criterio miliardi di documenti, tutta la conoscenza collezionata su internet. Parliamo di intelligenza aumentata perché vogliamo prendere le distanze dagli aspetti negativi che possono venire fuori dall’idea della sostituzione dell’umano, quello che sta avvenendo è un continuum del potenziamento delle capacità umane. Si tratta di uno strumento che viene utilizzato dall’essere umano, cui spetta il compito di decidere che uso farne.”